Con l’annuncio di Project GR00T, NVIDIA inaugura una nuova era per la robotica umanoide, introducendo una piattaforma che combina intelligenza artificiale generativa, simulazione avanzata e hardware accelerato per fornire ai robot capacità cognitive e motorie sempre più simili a quelle umane. GR00T — acronimo di Generalist Robot 00 Technology — è concepito come un foundation model destinato a servire come cervello generalista per robot umanoidi, capace di apprendere da video, istruzioni linguistiche e interazioni sensomotorie in ambienti fisici e virtuali.

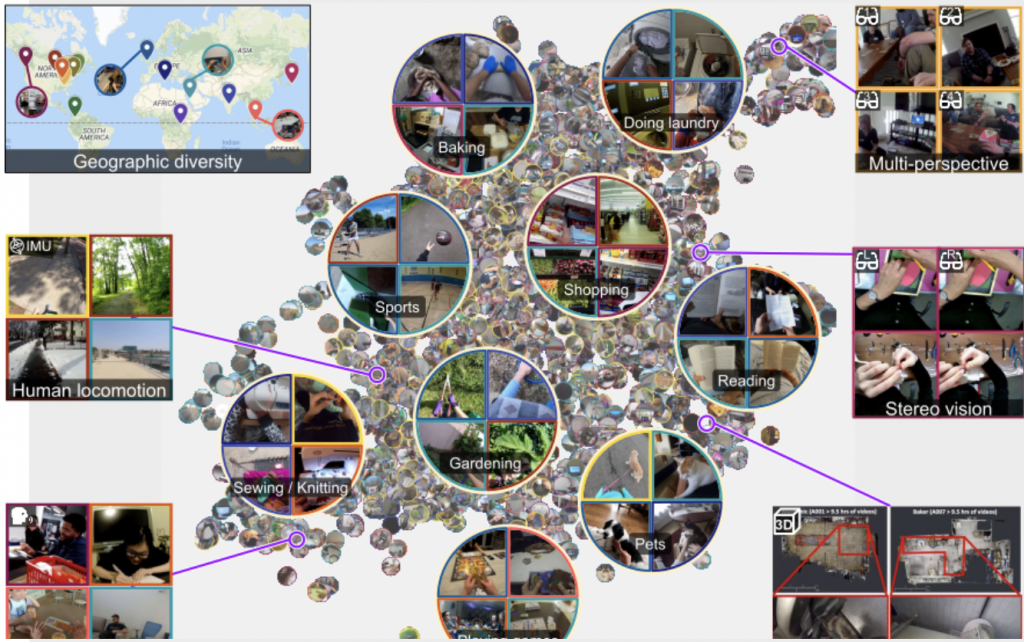

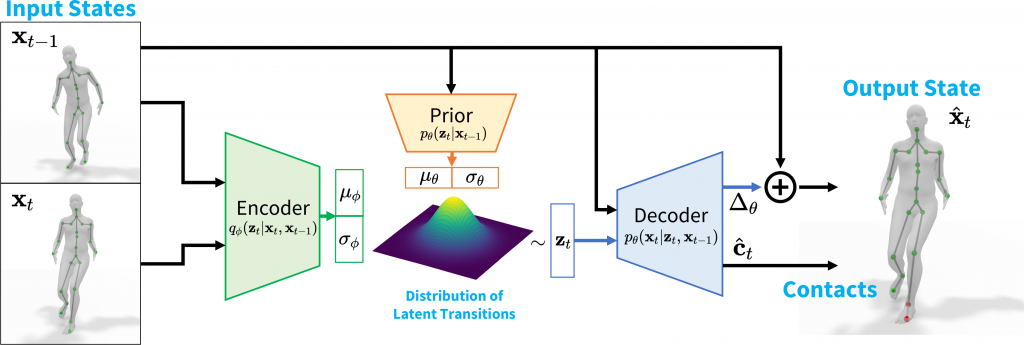

Alla base del progetto c’è l’idea di un modello multimodale in grado di generalizzare il comportamento attraverso ambienti, compiti e robot differenti, analogamente a quanto fatto da foundation model nel linguaggio naturale e nella visione artificiale. L’obiettivo di NVIDIA è quello di fornire una piattaforma integrata in grado di accelerare la ricerca e lo sviluppo di robot autonomi in grado di navigare, manipolare e interagire in ambienti complessi e non strutturati.

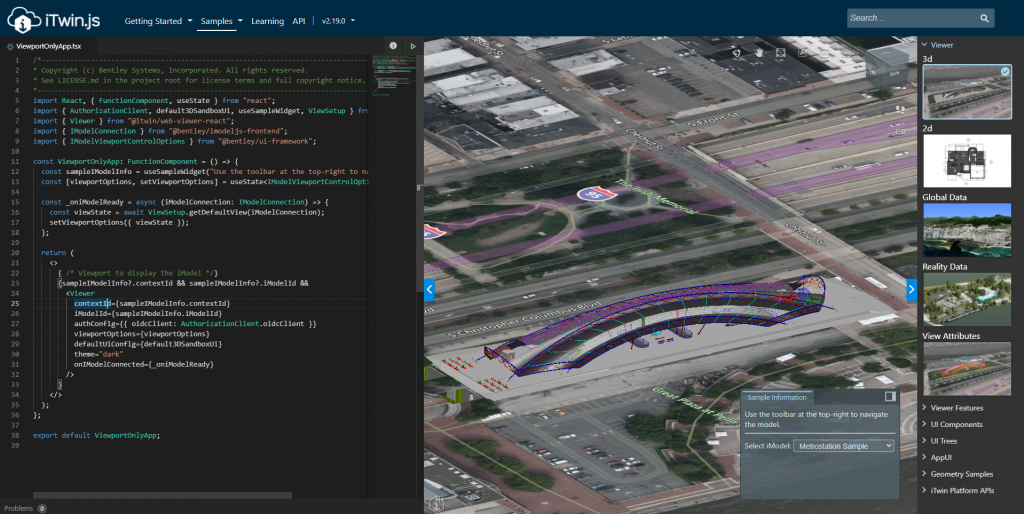

Il framework GR00T si integra strettamente con l’ecosistema Isaac, la piattaforma NVIDIA per la robotica, e in particolare con:

Isaac Lab

(per l’addestramento RL e simulato)

Isaac Sim

(per la simulazione fotorealistica in Omniverse)

Isaac ROS

(per l’esecuzione su robot reali).

In questo modo, NVIDIA propone una pipeline end-to-end che va dall’addestramento nel dominio simulato alla distribuzione nel mondo fisico, riducendo drasticamente il sim-to-real gap attraverso rendering avanzato, modellazione dinamica precisa e dominio adattivo.

La piattaforma è ottimizzata per girare sulla nuova generazione di moduli Jetson Thor, basati sull’architettura GPU NVIDIA Thor, capaci di eseguire modelli di AI generativa di grandi dimensioni direttamente a bordo del robot. Questo consente decisioni in tempo reale, inferenza locale e gestione di comportamenti complessi senza necessità di connessioni cloud continue — un passo cruciale per la robotica autonoma in tempo reale.

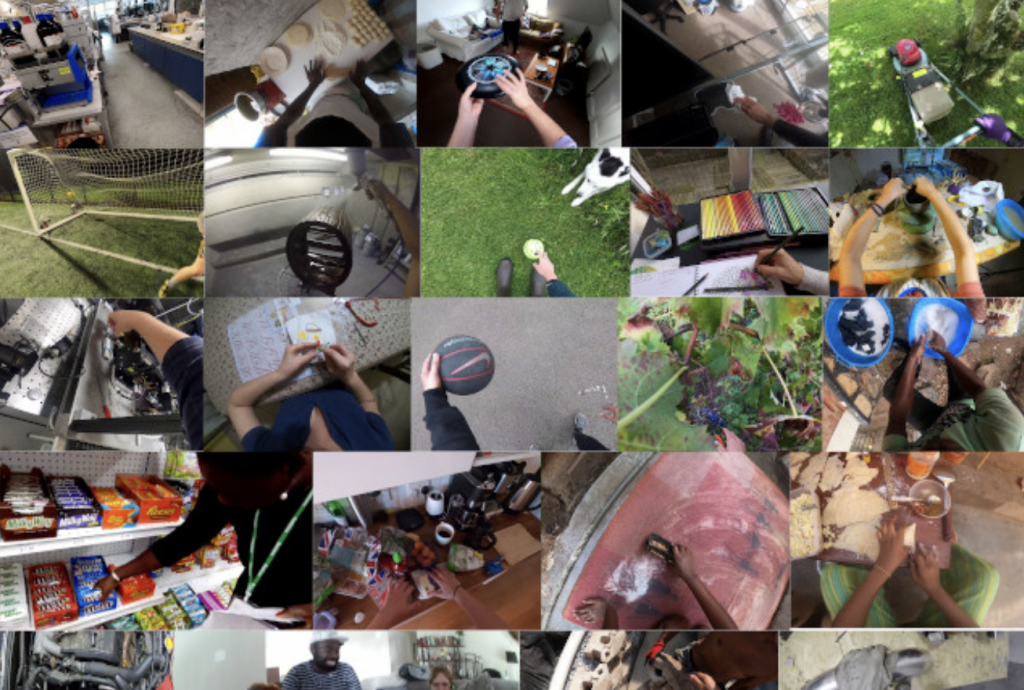

Il modello GR00T non si limita alla percezione, ma estende il suo dominio alla pianificazione motoria e alla comprensione semantica delle istruzioni, integrando moduli di NLP, Computer Vision e controllo motorio profondo. In termini pratici, questo significa che un robot addestrato con GR00T potrà, ad esempio, vedere un’azione in video e riprodurla, ricevere un comando vocale e decomporlo in sotto-azioni eseguibili, oppure apprendere nuove abilità attraverso l’osservazione.

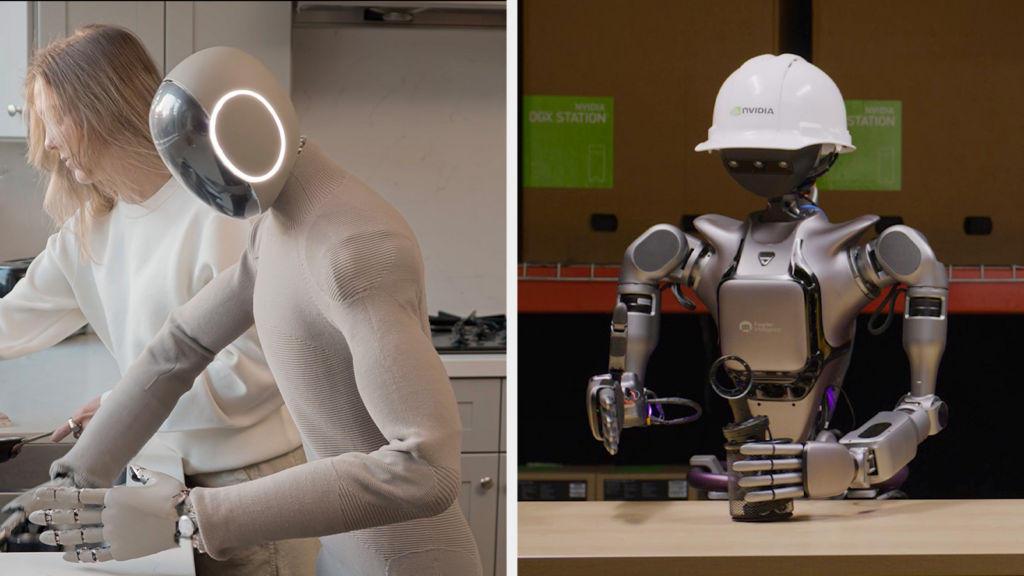

Importanti aziende nel settore della robotica umanoide — tra cui 1X Technologies, Agility Robotics, Boston Dynamics, Figure AI, Sanctuary AI, Unitree Robotics e molte altre — stanno già collaborando con NVIDIA per l’integrazione del modello GR00T nei loro sistemi. Questo suggerisce una convergenza dell’ecosistema industriale verso standard comuni, accelerando i tempi di adozione di robot realmente autonomi in applicazioni industriali, domestiche e sanitarie.

Per approfondire leggi l’articolo

d